Uso ético de los modelos de lenguaje de gran tamaño en marketing

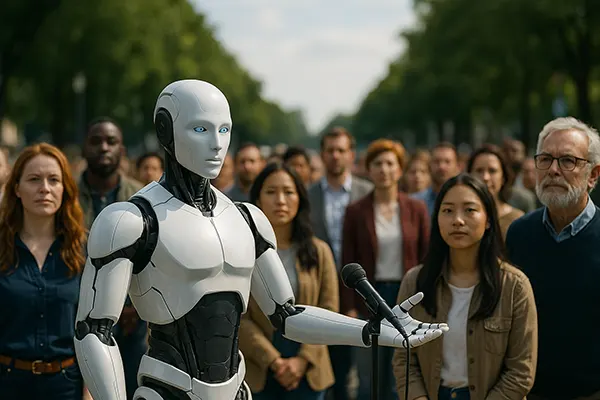

Los modelos de lenguaje de gran tamaño (LLMs) se han convertido rápidamente en una parte integral de las estrategias modernas de marketing, permitiendo a las empresas analizar el comportamiento del consumidor, generar contenido personalizado y optimizar la atención al cliente. Sin embargo, la creciente dependencia de estas herramientas en 2025 plantea cuestiones críticas sobre ética, transparencia y confianza. Cuando se implementan de forma responsable, los LLMs pueden mejorar la participación y la credibilidad de la marca, pero un uso indebido puede dañar la reputación, erosionar la confianza del consumidor y violar normas legales.

Transparencia y divulgación en el marketing impulsado por IA

En 2025, la conciencia de los consumidores sobre la inteligencia artificial ha crecido significativamente, y la transparencia es ahora una expectativa, no una opción. El marketing ético con LLMs comienza con la comunicación abierta cuando se ha utilizado IA para crear contenido, responder consultas o recomendar productos. Esta divulgación ayuda a mantener la confianza, especialmente en sectores donde la autenticidad es muy valorada.

Los especialistas en marketing también deben asegurarse de que los resultados generados por IA sean correctos y estén libres de sesgos. Los procesos de verificación de hechos deben integrarse en los flujos de trabajo, especialmente en campañas que involucren temas sensibles o regulados, como la salud o las finanzas. Al priorizar la precisión, las marcas pueden prevenir la desinformación y mantener el cumplimiento de las normas publicitarias.

Además, los marcos legales en regiones como el Reino Unido y la UE exigen cada vez más una divulgación clara de la toma de decisiones automatizada en las comunicaciones de marketing. Los especialistas en marketing ético van más allá del cumplimiento mínimo, utilizando la divulgación como una oportunidad para educar a los consumidores sobre los beneficios y limitaciones de la IA en marketing.

Recopilación de datos responsable y protección de la privacidad

Los LLMs dependen en gran medida de grandes conjuntos de datos para producir contenido relevante y personalizado. En 2025, las regulaciones de privacidad de datos como el RGPD del Reino Unido y la Ley de Servicios Digitales de la UE hacen esencial que los especialistas en marketing manejen los datos de los clientes con el mayor cuidado. El uso ético significa recopilar solo los datos necesarios para un propósito específico y garantizar que se procesen de manera segura.

La transparencia en el manejo de datos genera credibilidad. Esto incluye ofrecer opciones claras de suscripción para funciones de personalización y permitir a los usuarios controlar o eliminar sus datos. Las empresas que adoptan principios de privacidad desde el diseño en su marketing con LLMs no solo cumplen con las regulaciones, sino que también se diferencian como entidades confiables.

Además, los especialistas en marketing deben ser conscientes de los conjuntos de datos utilizados para entrenar los LLMs. Los sesgos en los datos de entrenamiento pueden generar resultados discriminatorios, lo que puede perjudicar tanto a los consumidores como a la marca. Las auditorías periódicas y las estrategias de mitigación de sesgos son componentes clave de una gobernanza ética de la IA en marketing.

Precisión, mitigación de sesgos e integridad de la marca

La precisión está en el núcleo del marketing ético. Los LLMs pueden generar contenido convincente pero inexacto si no se supervisa cuidadosamente. En sectores como los servicios financieros, la atención sanitaria o el asesoramiento legal, la exactitud no solo es una obligación moral, sino también un requisito legal. Las marcas que se toman en serio la precisión invierten en procesos de revisión humana antes de publicar contenido asistido por IA.

El sesgo en los resultados de IA sigue siendo uno de los retos éticos más urgentes. En 2025, muchas organizaciones adoptan métricas de equidad y herramientas de detección de sesgos para garantizar que las campañas de marketing no perpetúen estereotipos ni excluyan a determinados grupos demográficos de forma involuntaria. Estas medidas son fundamentales para construir mensajes de marca inclusivos y equitativos.

Mantener la integridad de la marca también requiere resistir la tentación de sobreoptimizar la IA para el compromiso a expensas de la veracidad. Los titulares sensacionalistas, el lenguaje manipulador o las afirmaciones exageradas pueden generar resultados a corto plazo, pero socavan la confianza a largo plazo. El marketing ético utiliza la IA para reforzar la credibilidad en lugar de explotar los sesgos cognitivos.

Supervisión humana y responsabilidad

Uno de los principios centrales del marketing ético con IA es que los humanos siguen siendo responsables de todos los resultados. Aunque los LLMs pueden acelerar la producción de contenido, la responsabilidad final recae en el equipo de marketing. Los flujos de trabajo claros que integran los resultados de IA con la revisión humana garantizan que la voz de la marca, el cumplimiento legal y los estándares éticos se mantengan.

La responsabilidad también implica supervisar los sistemas de IA después de su implementación. Incluso los LLMs bien entrenados pueden producir resultados no deseados con el tiempo debido a cambios en los datos o en las condiciones del mercado. Las revisiones continuas del rendimiento y las auditorías de contenido son esenciales para evitar que errores o infracciones éticas pasen desapercibidos.

En 2025, muchas marcas establecen comités internos de ética de IA para supervisar las políticas de uso, resolver disputas y garantizar que el despliegue de IA esté alineado con los valores corporativos. Estos comités suelen incluir especialistas legales, de marketing y tecnológicos que colaboran para mantener la coherencia ética en todas las campañas.

Generar confianza del consumidor mediante prácticas éticas de IA

La confianza es la moneda del marketing moderno, y el uso ético de la IA es una de las formas más eficaces de ganarla. Los consumidores recompensan cada vez más a las marcas que demuestran responsabilidad en su uso de la tecnología. Esto significa integrar principios éticos en todas las etapas de la integración de IA, desde la planificación y el entrenamiento hasta la ejecución y el seguimiento.

Las marcas líderes en la adopción ética de la IA suelen comunicar abiertamente sus políticas, publicar informes de transparencia y participar en diálogos públicos sobre sus prácticas. Esta apertura no solo tranquiliza a los clientes actuales, sino que también atrae a nuevos públicos que valoran la integridad y la responsabilidad en los negocios.

En última instancia, el uso ético de los LLMs en marketing no se trata solo de evitar sanciones regulatorias o daños a la reputación, sino de fomentar relaciones genuinas y duraderas con los consumidores. Al combinar la innovación tecnológica con valores centrados en las personas, las marcas pueden aprovechar la IA para crear un marketing eficaz y con principios.

Perspectivas futuras para la IA ética en marketing

De cara al futuro, el uso ético de los LLMs en marketing probablemente se convertirá en una ventaja competitiva en lugar de un simple requisito de cumplimiento. A medida que evolucionen las regulaciones y aumenten las expectativas de los consumidores, las marcas que no se adapten corren el riesgo de perder relevancia en un mercado que valora tanto la confianza como el rendimiento.

Se espera que los avances en herramientas de transparencia de IA, marcos de mitigación de sesgos y explicabilidad de IA faciliten el cumplimiento ético, pero no sustituirán la necesidad de una supervisión humana estratégica. Los especialistas en marketing deben mantenerse vigilantes, informados y proactivos en la aplicación responsable de estas innovaciones.

Para 2030, es posible que surjan programas de certificación de IA ética, que permitan a los consumidores identificar marcas que cumplan estrictos estándares éticos en el uso de la inteligencia artificial. Las empresas que empiecen a construir prácticas sólidas de IA ética hoy estarán mejor posicionadas para prosperar en este futuro panorama.